Quando a IA Supera Equipes

Em 2024, sistemas de IA elevaram sua taxa de resolução de problemas reais de código no benchmark SWE-bench de 4,4% para 71,7%, conforme o Stanford AI Index Report 2025. Esse salto quantitativo, documentado em avaliações de agentes autônomos, força uma reavaliação profunda das capacidades cognitivas distribuídas entre humanos e máquinas na engenharia de software. Na minha experiência como professor e pesquisador, observo que esse progresso não representa mera automação incremental, mas o início de uma transição paradigmática onde a escala computacional começa a desafiar a coordenação coletiva de equipes humanas, embora com limitações estruturais persistentes em raciocínio de longo horizonte e integração contextual.

Evolução dos Benchmarks de Codificação Autônoma

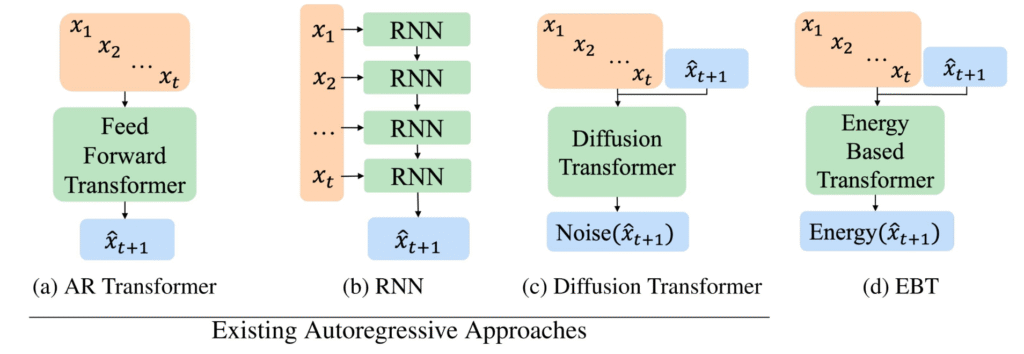

A trajetória da IA na geração e manutenção de código reflete avanços em modelos de linguagem grandes treinados em repositórios massivos, com arquiteturas transformer que capturam padrões sintáticos e semânticos em escala. Pesquisadores como os autores do paper original SWE-bench, publicado no arXiv por Jimenez et al. (2023), estabeleceram um padrão ao propor tarefas baseadas em issues reais do GitHub, exigindo não apenas geração de patches, mas compreensão de codebases complexos, execução de testes e iteração. Esse framework revelou inicialmente desempenhos humildes, com modelos como Claude 2 atingindo menos de 5% de resolução assistida.

Avanços subsequentes, incluindo Devin da Cognition e iterações de Claude e GPT, demonstraram scaling laws aplicadas à engenharia de software, onde o aumento de parâmetros, contexto estendido e fine-tuning em dados de repositórios elevou o desempenho de forma não linear. No entanto, benchmarks mais rigorosos como SWE-EVO destacam o fosso: enquanto em tarefas isoladas a IA alcança 70%+, em cenários de evolução de software de longo prazo com múltiplos arquivos, o desempenho cai para cerca de 25%, conforme relatórios de 2026. Isso ilustra que a codificação não se resume a completude sintática, mas a raciocínio arquitetural, trade-offs de design e alinhamento com requisitos evolutivos implícitos.

“A verdadeira medida de inteligência em programação não está na velocidade de geração, mas na capacidade de navegar ambiguidade e manter coerência sistêmica ao longo de iterações.”

Essa citação adaptada de reflexões em trabalhos da ACM sobre LLMs em engenharia reflete o cerne do debate atual.

Limites Cognitivos e o Paradoxo da Produtividade

Apesar dos ganhos em benchmarks, dados empíricos revelam um paradoxo: equipes que incorporam IA geram até 10x mais linhas de código, mas a produtividade líquida em valor entregue frequentemente permanece estagnada ou declina devido ao aumento de 1,7x em issues de qualidade, conforme relatório da CodeRabbit (2025). Estudos independentes, como o da METR (2025), indicam que desenvolvedores experientes podem até se tornar 19% mais lentos em tarefas objetivas quando dependem excessivamente de sugestões de IA, pois o tempo de verificação e correção de alucinações consome o ganho inicial.

Na minha experiência como professor e pesquisador orientando projetos de IA aplicada, equipes que tratam a IA como co-piloto estratégico, em vez de substituto, preservam a integridade arquitetural. Modelos como AlphaCode, do DeepMind (Li et al., 2022), exemplificam isso ao combinar geração massiva de candidatos com filtragem baseada em execução, alcançando níveis medianos em competições de programação. Todavia, em ambientes empresariais, o ruído introduzido por código superficialmente correto mas semanticamente frágil exige supervisão humana robusta, especialmente em domínios de alta confiabilidade como sistemas embarcados ou finanças.

Dica Estratégica: Priorize orquestração híbrida onde a IA gerencia tarefas de baixa ambiguidade (refatoração, testes unitários) e humanos retêm o controle de interfaces e requisitos não-funcionais. Essa divisão maximiza o multiplier de velocidade sem comprometer a resiliência sistêmica.

Visão Científica e de Mercado

O impacto transcende o código para reconfigurar ecossistemas de pesquisa, mercado de trabalho e políticas. Na ciência, ferramentas de IA aceleram prototipagem em computação científica, permitindo que pesquisadores explorem hipóteses mais rapidamente, como demonstrado em surveys da CHI Conference sobre LLMs em programação científica. Economicamente, relatórios indicam declínio de 13-20% em contratações de desenvolvedores juniores (22-25 anos) em ocupações expostas à IA, segundo Stanford Digital Economy Lab (2025), enquanto seniors ganham produtividade de até 3,6% em commits, conforme estudo publicado na Science (Daniotti et al., 2026).

Empresas enfrentam um “hollowing out” da pirâmide de talentos: juniors perdem oportunidades de aprendizado on-the-job, potencialmente ampliando gaps de skills. No mercado, firmas como GitHub e Anthropic reportam adoção massiva, com 84% dos desenvolvedores usando ferramentas de IA em 2025 (Stack Overflow Survey). Politicamente, isso impulsiona debates sobre regulação de IA em infraestrutura crítica, upskilling público e mitigação de desigualdades, com governos europeus e asiáticos investindo em currículos híbridos humano-IA. O humor sutil reside na ironia: a ferramenta que promete eliminar o tédio da codificação rotineira cria, paradoxalmente, mais trabalho de revisão e governança ética para os mesmos profissionais.

Após essa análise dos benchmarks e impactos, é essencial conectar teoria à prática avançada. Para dominar a orquestração de agentes de IA em pipelines reais de engenharia, acesse https://ia.pro.br e explore nossos programas de certificação em IA aplicada à software engineering.

Desdobramento Metodológico: Framework Híbrido para Equipes Aumentadas por IA

Um caso prático ilustra a aplicação: em projetos de migração de legados, implementamos um pipeline onde agentes de IA (baseados em Claude ou equivalentes) lidam com detecção e refatoração inicial de padrões, enquanto revisores humanos validam alinhamento com domínio. Métricas de sucesso incluem redução de 40-60% no tempo de sprint para tarefas repetitivas, mas com manutenção de taxa de defeitos abaixo de 5% através de gates de aprovação humana. Esse framework, inspirado em Agentless e OpenHands, enfatiza feedback loops contínuos e avaliação de confiança calibrada.

| Aspecto | Equipe Humana Pura | Equipe Híbrida IA-Humana | Ganho Observado |

|---|---|---|---|

| Velocidade de Geração | Baseline | 1.7-2.0x | Alto em tarefas isoladas |

| Qualidade (Defeitos/PR) | Baixa churn | +1.7x issues iniciais | Requer gates humanos |

| Raciocínio Longo Prazo | Forte | Limitado (25% SWE-EVO) | Híbrido essencial |

| Inovação Arquitetural | Alta | Média-Alta | Humanos lideram |

| Custo por Feature | Alto | Reduzido em 30-50% | Dependente de maturidade |

Essa tabela comparativa, derivada de consolidação de benchmarks e relatórios de campo, destaca que o “dia” em que a IA supera equipes não é binário, mas gradual e condicional a integração inteligente.

O Legado da Colaboração Humano-Máquina na Engenharia Cognitiva

O verdadeiro legado não reside na substituição, mas na elevação da engenharia de software a uma disciplina mais abstrata, focada em orquestração de inteligências heterogêneas, validação ética e inovação em escala. Pesquisadores como aqueles por trás dos trabalhos da Nature sobre sustentabilidade em programação de IA alertam para custos ambientais, com modelos emitindo até 19 vezes mais CO₂ que humanos em tarefas equivalentes. Isso reforça a necessidade de modelos eficientes e SLMs especializados.

Na minha experiência como professor e pesquisador, os profissionais que prosperarão serão aqueles que desenvolvem meta-habilidades: prompt engineering avançado, avaliação crítica de outputs e design de sistemas socio-técnicos. O futuro não elimina o programador, mas redefine seu papel como arquiteto de ecossistemas cognitivos.

Para aplicar esses conceitos em projetos reais e acelerar sua curva de aprendizado com agentes autônomos, visite https://ia.pro.br e junte-se à comunidade de líderes em IA estratégica.

FAQ

### A IA já resolve mais de 70% dos problemas reais de código em benchmarks?

Sim, conforme o Stanford AI Index 2025, o progresso no SWE-bench Verified foi notável, saltando para acima de 70% em modelos líderes. No entanto, isso se aplica a subsets verificados; em repositórios complexos e tarefas evolutivas de longo prazo (SWE-EVO), o desempenho permanece em torno de 25%, revelando limitações em planejamento multi-etapa e correção de deriva contextual.

### Como a IA impacta o emprego de desenvolvedores juniores?

Estudos da Stanford Digital Economy Lab indicam declínio de 13-20% em contratações para faixas etárias 22-25 em papéis expostos à IA. A automação de tarefas rotineiras reduz oportunidades de entrada, enquanto seniors capturam a maior parte dos ganhos de produtividade, potencialmente criando uma lacuna geracional que exige políticas de reskilling direcionadas.

### Qual o papel da supervisão humana em equipes com IA?

A supervisão permanece essencial para alinhamento estratégico, mitigação de alucinações e decisões arquiteturais de alto impacto. Relatórios mostram que IA introduz mais issues de qualidade, tornando o humano o responsável pela integridade sistêmica, segurança e conformidade ética.

### Quais benchmarks definem o estado-da-arte em codificação por IA?

SWE-bench e suas variantes (Verified, Pro, EVO) são padrões ouro, complementados por BigCodeBench e LiveCodeBench. Eles testam desde geração de funções isoladas até resolução autônoma de issues em codebases reais, com ênfase crescente em agentic behavior e long-horizon reasoning.

### A IA programará sozinha sistemas complexos em 5 anos?

Previsões variam, mas evidências atuais sugerem um cenário híbrido persistente. Avanços em agentes multi-modais e self-improving systems são promissores, mas desafios em confiabilidade, commonsense reasoning e integração com mundos físicos indicam que a colaboração humano-IA permanecerá dominante para missões críticas.

### Como medir ROI de adoção de IA em engenharia de software?

Além de linhas de código ou velocidade de PRs, inclua métricas como churn de código, taxa de defeitos em produção, tempo de onboarding e satisfação da equipe. Estudos Bain e GitClear mostram que ganhos brutos em velocidade frequentemente mascaram custos de manutenção elevados.

Referências Bibliográficas

- Stanford AI Index Report 2025. Stanford University Human-Centered AI.

- Jimenez et al. (2023). SWE-bench: Can Language Models Resolve Real-World GitHub Issues? arXiv.

- Daniotti et al. (2026). Who is using AI to code? Science.

- Li et al. (2022). Competition-level code generation with AlphaCode. DeepMind.

- CodeRabbit State of AI vs Human Code Generation Report (2025).

- METR Research (2025). Early 2025 AI Experienced OS Dev Study.

- Cognition Labs. Devin Technical Report (2024).

- Stack Overflow Developer Survey 2025.

- Woo et al. (2025). Comparative study of AI and human programming on environmental sustainability. Scientific Reports (Nature).

- Gu et al. (2025). Challenges and Paths Towards AI for Software Engineering.

- Bain & Company. Generative AI in Software Development Report (2025).

- Peng et al. (2023). The Impact of AI on Developer Productivity. arXiv.

- Westby et al. (2025). The Impact of Generative AI on Job Opportunities for Junior Software Developers.

- OpenHands and SWE-agent frameworks documentation (2024-2026).

Formato 1 (Tags): ia-programacao, swe-bench, engenharia-software-ia, produtividade-desenvolvedores, agentes-autonomos, futuro-trabalho-tecnologia, ia-cognitiva, benchmarks-ia

Formato 2 (Hashtags): #IAProgramacao #SWEbench #EngenhariaSoftwareIA #ProdutividadeDev #AgentesIA #FuturoTrabalho #InteligenciaArtificial #CodingAI

Créditos: Professor de IA Maiquel Gomes — maiquelgomes.com | ia.pro.br. Ao citar ou reproduzir este conteúdo, favor referenciar o Professor Maiquel Gomes (https://maiquelgomes.com).

Graduado em Ciências Atuariais pela Universidade Federal Fluminense (UFF) e Mestrando em IA no Instituto de Computação da UFF (nota máxima no CAPES). Palestrante e Professor de Inteligência Artificial e Linguagem de Programação; autor de livros, artigos e aplicativos.

Professor do Grupo de Trabalho em Inteligência Artificial da UFF (GT-IA/UFF) e do Laboratório de Inovação, Tecnologia e Sustentabilidade (LITS/UFF), entre outros projetos.

Proprietário dos projetos:

entre outros.

💫 Apaixonado pela vida, pelas amizades, pelas viagens, pelos sorrisos, pela praia, pelas baladas, pela natureza, pelo jazz e pela tecnologia.