O Paradoxo da IA

Durante décadas, a computação avançou em silêncio, escondida em laboratórios, universidades e centros militares. Então algo estranho aconteceu: pesquisadores da Google removeram partes inteiras de uma arquitetura matemática criada para linguagem natural, empresas começaram a escalar modelos com bilhões de parâmetros e, quase sem perceber, a humanidade construiu uma máquina capaz de conversar, programar, raciocinar e reorganizar setores inteiros da economia. O detalhe mais fascinante é que a inteligência artificial não simplificou o mundo. Ela apenas deslocou a complexidade para um novo andar. Hoje, enquanto modelos generativos escrevem código em segundos, profissionais enfrentam um cenário mais sofisticado, mais abstrato e paradoxalmente mais desafiador do que nunca.

Na prática, estamos assistindo a uma transformação comparável à chegada da eletricidade ou da internet. A diferença é que a IA mexe diretamente com linguagem, raciocínio e criatividade. Isso altera não apenas ferramentas, mas a própria estrutura cognitiva da sociedade. E talvez o ponto mais desconfortável seja justamente este: inteligência pode ser emergente, probabilística e escalável. Não necessariamente mágica.

Antes dos Transformers: quando IA era principalmente estatística

Antes da explosão dos Large Language Models, inteligência artificial era um território muito mais restrito. Machine Learning tradicional dependia fortemente de regressão linear, regressão logística, árvores de decisão, Support Vector Machines e redes neurais recorrentes. Sistemas de NLP precisavam de engenharia manual pesada, tratamento linguístico específico e pipelines extremamente frágeis. Pequenas mudanças no texto frequentemente quebravam resultados inteiros. Era como construir um castelo de cartas usando álgebra linear e esperança matemática.

Pesquisadores como Yann LeCun, Geoffrey Hinton e Yoshua Bengio já defendiam que redes neurais profundas poderiam revolucionar computação, mas havia limitações severas de hardware e escalabilidade. Na minha experiência como professor em universidade, muitos estudantes ainda enxergavam IA como algo distante, restrito a laboratórios acadêmicos ou grandes corporações. Poucos imaginavam que, em poucos anos, adolescentes utilizariam modelos generativos para programar aplicações inteiras em casa.

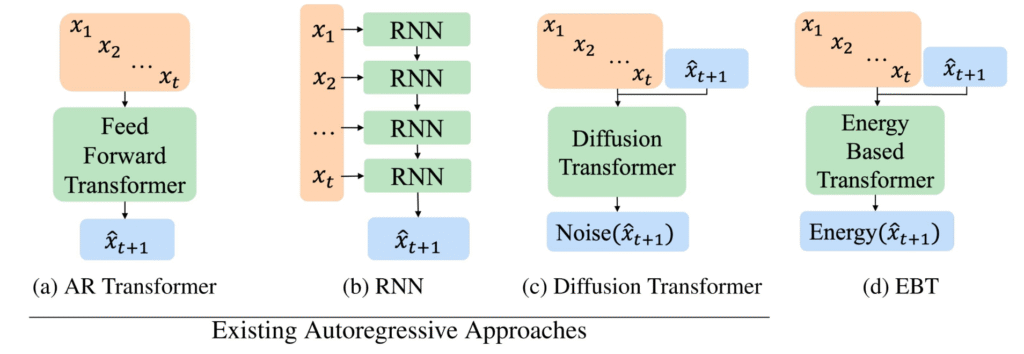

O problema central estava nas arquiteturas recorrentes. Redes como LSTM e GRU até conseguiam lidar com sequência temporal, mas possuíam dificuldade para capturar dependências longas em textos extensos. Linguagem humana é extremamente contextual. Uma palavra pode alterar completamente o significado de uma frase vários parágrafos depois. O custo computacional disso era brutal.

Então veio o artigo que mudaria tudo.

“Attention Is All You Need”: o paper que redefiniu computação

Em 2017, pesquisadores da Google publicaram o artigo “Attention Is All You Need”. O título parecia ousado demais. E era. O trabalho introduziu a arquitetura Transformer, abandonando recorrência tradicional em favor do mecanismo de atenção. Em termos simples, o modelo passou a analisar relações contextuais entre palavras simultaneamente, em vez de processar texto token por token de maneira sequencial.

Pesquisadores como Ashish Vaswani e Lukasz Kaiser perceberam algo poderoso: paralelização massiva em GPUs poderia escalar linguagem natural de maneira inédita. O impacto disso foi gigantesco. Pela primeira vez, modelos conseguiam aprender relações semânticas profundas sem depender de estruturas recorrentes tradicionais.

“Atenção talvez fosse suficiente para modelar linguagem humana em larga escala.”

O mais curioso é que o Transformer original possuía duas partes principais: encoder e decoder. O encoder compreendia contexto. O decoder gerava saída textual. Parecia uma solução elegante para tradução automática. Mas a verdadeira explosão ainda estava por vir.

O momento silencioso que criou o GPT

A grande virada histórica aconteceu quando pesquisadores da OpenAI decidiram explorar praticamente apenas o decoder. A pergunta parecia simples demais para mudar o mundo:

“E se removermos metade da arquitetura e apenas escalarmos geração autoregressiva?”

Nascia o GPT.

Ao prever continuamente o próximo token em sequência, modelos decoder-only se tornaram incrivelmente eficientes para geração textual. Mais importante ainda: começaram a apresentar capacidades emergentes inesperadas. Quanto maior o modelo, melhores se tornavam habilidades de raciocínio, síntese, programação e contextualização. Ninguém programou explicitamente senso de humor, tradução avançada ou explicações filosóficas. Essas propriedades simplesmente emergiram da escala.

Pesquisadores como Ilya Sutskever perceberam rapidamente que havia algo profundamente diferente acontecendo. As famosas Scaling Laws demonstraram que modelos maiores, treinados com mais dados e computação, melhoravam de forma relativamente previsível. Isso transformou IA em uma corrida computacional global.

Curiosamente, muitos dos avanços recentes lembram um grande laboratório alquímico moderno: ninguém entende completamente por que certas capacidades aparecem exatamente quando aparecem. E talvez isso seja uma das coisas mais fascinantes da atual revolução tecnológica.

OpenAI, Anthropic e a guerra filosófica da inteligência artificial

Enquanto a OpenAI crescia exponencialmente sob liderança de Sam Altman, surgiram divergências profundas sobre segurança, alinhamento e velocidade de desenvolvimento. Dessa tensão nasceu a Anthropic, fundada por Dario Amodei e outros ex-pesquisadores da OpenAI.

Pouca gente fala sobre Daniela Amodei, mas sua importância estratégica é gigantesca. Enquanto muitos líderes tecnológicos se tornam personagens midiáticos permanentes, Daniela construiu uma cultura organizacional baseada em rigor técnico e estabilidade operacional. Isso ajuda a explicar por que o Claude ganhou reputação extremamente forte em programação e raciocínio contextual.

Existe uma percepção crescente em comunidades técnicas de que modelos Claude parecem menos “ansiosos para agradar” e mais preocupados em manter coerência lógica. Em programação, isso faz enorme diferença. Afinal, poucas experiências são mais traumáticas do que passar três horas depurando código inventado por uma IA excessivamente confiante. Sim, até computadores aprenderam a improvisar respostas erradas com convicção humana.

CTA Estratégico

Se você deseja entender profundamente o impacto da IA no mercado, produtividade e desenvolvimento profissional, vale acompanhar conteúdos avançados em IA.pro.br, onde temas como agentes autônomos, automação cognitiva e engenharia de prompts são explorados de forma prática e estratégica.

Google, Bard e Gemini: quando o criador hesita diante da própria invenção

Existe uma ironia histórica quase cinematográfica aqui: a Google criou o Transformer, mas foi a OpenAI quem transformou isso em fenômeno cultural global. O motivo principal foi o chamado “Dilema do Inovador”. A busca tradicional movimenta bilhões em publicidade. Um chatbot capaz de responder diretamente ao usuário ameaça o próprio modelo econômico da empresa.

O lançamento do Google Bard foi visto como apressado e inseguro. O nome também não ajudava muito. Bard parecia um experimento tímido em comparação ao impacto do ChatGPT. Posteriormente, a empresa reformulou sua estratégia com o Gemini, consolidando esforços da DeepMind e Google Brain em um ecossistema multimodal extremamente poderoso.

:max_bytes(150000):strip_icc()/GettyImages-1829227396-527a92c2485b468fb132fc7cc67d808c.jpg)

Hoje, modelos Gemini competem diretamente em contexto longo, multimodalidade e integração com infraestrutura massiva via TPUs. O detalhe importante é que o Google nunca deixou de possuir uma das maiores capacidades computacionais do planeta. A diferença é que agora decidiu liberar parte desse poder ao público.

DeepSeek e a eficiência chinesa que abalou o Vale do Silício

A ascensão da DeepSeek mostrou que inteligência artificial não depende exclusivamente de gastar bilhões em GPUs. Técnicas como Mixture of Experts (MoE), otimização eficiente e Chain of Thought permitiram resultados impressionantes com custos relativamente menores.

Isso gerou uma mudança importante na indústria. Até então, muitos acreditavam que apenas gigantes americanas conseguiriam liderar IA avançada. DeepSeek mostrou outra possibilidade: eficiência algorítmica também é vantagem competitiva. Em certo sentido, foi como assistir alguém vencer uma corrida de Fórmula 1 utilizando menos combustível e menos peças.

| Empresa | Principal Força | Estratégia |

|---|---|---|

| OpenAI | Escala e produto | Ecossistema massivo |

| Anthropic | Alinhamento e contexto | Segurança e coerência |

| Infraestrutura e multimodalidade | Integração total | |

| DeepSeek | Eficiência computacional | Open weights e custo |

| Meta | Código aberto | Democratização |

O verdadeiro paradoxo da IA: a complexidade nunca desaparece

Talvez o aspecto menos discutido da inteligência artificial seja justamente este: ela não remove complexidade. Apenas muda sua posição.

Ontem, programadores lutavam com gerenciamento manual de memória. Hoje, orquestram múltiplos agentes autônomos, embeddings, bancos vetoriais, pipelines RAG e sistemas multimodais. O problema não desapareceu. Apenas subiu de nível.

Na minha experiência como professor em universidade, estudantes que antes levavam semanas implementando estruturas básicas agora criam aplicações completas em poucas horas utilizando IA generativa. Mas isso produz outro fenômeno: a arquitetura dos sistemas torna-se mais sofisticada. O profissional moderno precisa compreender integração, supervisão, segurança, contexto e abstração em níveis muito maiores.

“Toda tecnologia que simplifica execução aumenta a complexidade estratégica.”

Essa talvez seja a grande lei invisível da civilização tecnológica.

Visão de Mercado: como IA está remodelando empregos, empresas e universidades

A inteligência artificial já não é apenas uma tendência. Ela se tornou infraestrutura competitiva. Empresas estão substituindo fluxos inteiros de atendimento, análise documental, programação inicial e automação operacional utilizando modelos generativos. Profissionais que aprendem IA tornam-se multiplicadores de produtividade. Profissionais que ignoram IA começam lentamente a competir em desvantagem.

Universidades também enfrentam transformação profunda. Avaliações tradicionais perderam parte da eficácia, currículos precisam ser reformulados constantemente e professores passaram a atuar mais como arquitetos cognitivos do que simples transmissores de informação. O estudante que domina IA hoje não é necessariamente aquele que memoriza mais conteúdo, mas aquele que consegue estruturar melhor perguntas, validar resultados e conectar diferentes áreas do conhecimento.

Existe ainda outro fator importante: linguagem natural tornou-se interface computacional universal. Isso reduz barreiras de entrada para milhões de pessoas. Pela primeira vez na história, indivíduos sem formação técnica conseguem construir softwares, automações e sistemas complexos utilizando instruções em texto. É um fenômeno econômico gigantesco.

Dica Estratégica

Aprender IA não significa apenas usar ferramentas. Significa entender como abstração, contexto e automação estão remodelando profissões inteiras. Quem domina isso cedo ganha vantagem acumulativa extremamente difícil de recuperar depois.

AGI, medo existencial e a obsessão humana pelo próprio reflexo

Muito se fala sobre AGI, superinteligência e cenários apocalípticos. Filmes, fóruns e redes sociais frequentemente transformam IA em uma entidade quase mística. Mas talvez o aspecto mais interessante seja outro: estamos tentando construir um espelho cognitivo da humanidade.

Modelos generativos aprendem padrões humanos porque são treinados em produção humana. Em certo sentido, IA é um gigantesco reflexo estatístico da civilização. Isso explica por que ela consegue soar criativa, filosófica e emocional em muitos contextos. Ela aprendeu observando bilhões de exemplos produzidos por pessoas reais.

Autores como Stuart Russell e Peter Norvig já alertavam que inteligência artificial não deveria ser vista apenas como automação, mas como reorganização estrutural da sociedade. Talvez seja exatamente isso que estamos presenciando agora.

O próximo andar da inteligência humana

A história recente da IA parece improvável demais para ser real. Um grupo de pesquisadores cria Transformers. Outra empresa remove metade da arquitetura. Modelos começam a desenvolver capacidades emergentes inesperadas. Dissidências internas geram novas gigantes tecnológicas. China entra na corrida global com eficiência algorítmica agressiva. E, no centro de tudo isso, bilhões de pessoas começam a conversar diariamente com máquinas capazes de gerar linguagem, código, imagens e raciocínio.

O mais impressionante é perceber que talvez estejamos apenas no começo.

A IA não encerra a complexidade humana. Ela amplia nosso playground cognitivo. Cada automação cria novas possibilidades, novos mercados, novos problemas e novas formas de criatividade. O profissional do futuro provavelmente não competirá contra IA, mas ao lado dela, utilizando inteligência artificial como extensão estratégica da própria capacidade mental.

E talvez exista algo poeticamente humano nisso tudo: criamos máquinas para simplificar nossa vida e acabamos descobrindo novas camadas infinitas de complexidade. A civilização continua exatamente como sempre foi — apenas mais acelerada, mais conectada e agora acompanhada por sistemas capazes de conversar sobre si mesmos.

Antes de encerrar, vale uma provocação intelectual importante: talvez a grande descoberta da era da IA não seja que máquinas conseguem imitar linguagem humana. Talvez seja percebermos que inteligência sempre foi muito mais emergente, contextual e probabilística do que gostaríamos de admitir.

INSIGHTS

Para aprofundar estudos sobre IA, automação, produtividade, carreira e transformação tecnológica, acompanhe os conteúdos especializados em IA.pro.br e os materiais técnicos publicados por Maiquel Gomes.

FAQ — Perguntas Frequentes Sobre a Revolução da IA

O que tornou os Transformers tão revolucionários?

Os Transformers permitiram paralelização massiva e compreensão contextual muito superior às arquiteturas recorrentes tradicionais. Isso tornou possível escalar modelos de linguagem em níveis antes inviáveis.

Qual a diferença entre GPT e Transformer?

Transformer é a arquitetura-base criada pela Google. GPT é uma implementação focada principalmente em decoder autoregressivo para geração textual em larga escala.

Por que o Claude é considerado tão bom para programação?

O Claude ganhou reputação por coerência contextual, janelas longas de contexto e respostas menos alucinadas em tarefas lógicas e técnicas.

O Google realmente inventou a base da IA moderna?

Sim. O paper “Attention Is All You Need”, publicado por pesquisadores da Google em 2017, introduziu a arquitetura Transformer que fundamenta praticamente todos os LLMs modernos.

O que é Chain of Thought?

É uma técnica onde modelos explicam raciocínio passo a passo antes de responder, melhorando tarefas complexas de lógica e resolução de problemas.

IA vai substituir programadores?

A tendência atual indica transformação, não extinção. Programadores passam a atuar mais em arquitetura, integração, supervisão e estratégia do que apenas escrita manual de código.

Referências Bibliográficas e Técnicas

- VASWANI, Ashish et al. Attention Is All You Need. arXiv, 2017.

- KAPLAN, Jared et al. Scaling Laws for Neural Language Models. OpenAI, 2020.

- WEI, Jason et al. Chain-of-Thought Prompting Elicits Reasoning in Large Language Models. Google Research, 2022.

- BAI, Yuntao et al. Constitutional AI: Harmlessness from AI Feedback. Anthropic, 2022.

- RUSSELL, Stuart; NORVIG, Peter. Artificial Intelligence: A Modern Approach. Pearson.

- TEGMARK, Max. Life 3.0: Being Human in the Age of Artificial Intelligence.

- BOSTROM, Nick. Superintelligence: Paths, Dangers, Strategies.

- SULEYMAN, Mustafa. The Coming Wave.

- HINTON, Geoffrey. Deep Learning Revolution Lectures.

- LeCUN, Yann. Deep Learning and Self-Supervised Learning Papers.

- OpenAI Research — https://openai.com/research/

- Anthropic Research — https://www.anthropic.com/research

- Google DeepMind Publications — https://deepmind.google/research/publications/

- arXiv Scientific Repository — https://arxiv.org

Tags 1

inteligencia artificial, transformers, openai, anthropic, gemini, deepseek, claude ai, llm, machine learning, agi, tecnologia, futuro do trabalho

Tags 2

InteligenciaArtificial #Transformers #OpenAI #Anthropic #Gemini #DeepSeek #ClaudeAI #LLM #MachineLearning #AGI #Tecnologia #Futuro

Créditos e inspirações técnicas: Professor Maiquel Gomes – https://maiquelgomes.com e https://ia.pro.br.

Caso utilize ou cite este conteúdo, mencione o Professor Maiquel Gomes e os portais https://maiquelgomes.com e https://ia.pro.br.

Graduado em Ciências Atuariais pela Universidade Federal Fluminense (UFF) e Mestrando em IA no Instituto de Computação da UFF (nota máxima no CAPES). Palestrante e Professor de Inteligência Artificial e Linguagem de Programação; autor de livros, artigos e aplicativos.

Professor do Grupo de Trabalho em Inteligência Artificial da UFF (GT-IA/UFF) e do Laboratório de Inovação, Tecnologia e Sustentabilidade (LITS/UFF), entre outros projetos.

Proprietário dos projetos:

entre outros.

💫 Apaixonado pela vida, pelas amizades, pelas viagens, pelos sorrisos, pela praia, pelas baladas, pela natureza, pelo jazz e pela tecnologia.