1. Introdução

A rápida evolução da Inteligência Artificial (IA) tem transformado diversos setores, e a cibersegurança não é exceção. A IA, com suas capacidades de processamento e análise de grandes volumes de dados, tornou-se uma ferramenta indispensável para fortalecer as defesas cibernéticas em um cenário de ameaças cada vez mais sofisticadas e voláteis¹. A integração da IA na cibersegurança está profundamente transformando a forma como as organizações detectam, previnem e respondem a ameaças digitais²,³. Sistemas baseados em IA automatizam processos de segurança, analisam grandes quantidades de dados e se adaptam em tempo real às ameaças em evolução¹,⁴.

No entanto, essa mesma tecnologia é um “fio de dois gumes”⁵, sendo também explorada por agentes mal-intencionados para orquestrar ataques mais complexos e evasivos⁶,⁷. A capacidade da IA de simular o comportamento humano emergiu como uma ameaça significativa à cibersegurança, permitindo a automação de processos de penetração e coleta de dados sensíveis⁸.

A crescente digitalização e a vasta quantidade de dados gerados pelas organizações criam uma superfície de ataque expandida, tornando defesas cibernéticas robustas mais críticas do que nunca¹. A proliferação de dados leva a uma superfície de ataque maior, e a velocidade e o volume das ameaças superam a capacidade humana de resposta⁹. Isso significa que a IA não é mais um “luxo”, mas uma “infraestrutura essencial” para manter a segurança em um ambiente digital complexo e em constante evolução. A IA surge como uma solução para automatizar tarefas repetitivas, reduzir a sobrecarga das equipes de segurança e permitir que profissionais se concentrem em riscos de maior prioridade e melhorias estratégicas¹.

O mercado global de produtos de cibersegurança baseados em IA, estimado em US$ 15 bilhões em 2021, projeta um crescimento exponencial para aproximadamente US$ 135 bilhões até 2030¹⁰, e US$ 102.78 bilhões até 2032¹¹. Esse crescimento projetado sugere uma mudança fundamental na alocação de recursos e na priorização estratégica das organizações. A IA se tornará o principal vetor de investimento em segurança, potencialmente redefinindo os orçamentos de TI e as estruturas de equipes de segurança. O salto nos valores de mercado não é apenas um aumento incremental, mas uma transformação que implica que as empresas estão realocando orçamentos significativos para soluções baseadas em IA. Essa priorização pode levar a uma reestruturação das equipes de segurança, com menos foco em tarefas manuais e mais em supervisão de IA e análise estratégica, conforme sugerido pela redução da sobrecarga humana¹.

Este artigo visa fornecer uma análise abrangente do papel da Inteligência Artificial no domínio da cibersegurança, explorando suas aplicações defensivas e ofensivas, os desafios inerentes à sua implementação e as implicações éticas e regulatórias. O escopo abrange desde os fundamentos da IA até as estratégias de mitigação e as perspectivas futuras, com base em uma revisão sistemática da literatura científica e de fontes de alta visibilidade.

O restante do artigo está organizado da seguinte forma: A Seção 2 apresenta uma revisão da literatura sobre os fundamentos e a evolução da IA em cibersegurança. A Seção 3 detalha a metodologia de pesquisa. A Seção 4 analisa o papel dual da IA, tanto na defesa quanto no ataque cibernético, com dados comparativos. A Seção 5 discute os desafios, implicações éticas e legais, e as estratégias de mitigação. Finalmente, a Seção 6 conclui o estudo, apontando limitações e direções para pesquisas futuras.

2. Revisão da Literatura: Fundamentos e Evolução da IA em Cibersegurança

2.1. Definições e Conceitos Essenciais de IA

A Inteligência Artificial (IA) representa a capacidade de uma máquina em reproduzir habilidades semelhantes às humanas, englobando aspectos como raciocínio, aprendizagem, planejamento e criatividade¹². Os conceitos fundamentais da IA incluem algoritmos de Aprendizado de Máquina (ML), Redes Neurais Artificiais, Processamento de Linguagem Natural (NLP) e Visão Computacional¹³.

- Aprendizado de Máquina (ML): É um subcampo da IA que permite que os sistemas aprendam e melhorem ao longo do tempo a partir de dados, sem programação explícita⁴. No contexto da cibersegurança, técnicas de ML como árvores de decisão, Máquinas de Vetores de Suporte (SVM) e Random Forest são amplamente utilizadas na detecção de ameaças, identificando anomalias no tráfego de rede e padrões de ataque específicos¹⁴,¹⁵,¹⁶. Modelos baseados em ML demonstram capacidades de detecção eficazes quando há dados de treinamento suficientes e boa generalização para identificar variações e novas ameaças¹⁴.

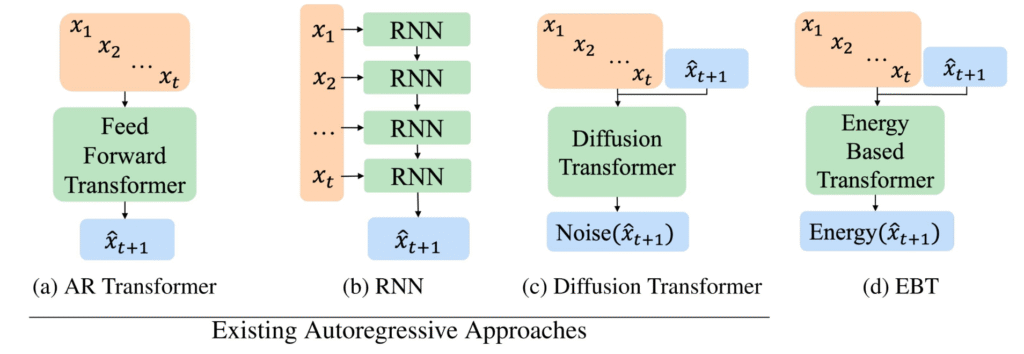

- Aprendizado Profundo (DL): Um subcampo mais avançado do ML que utiliza redes neurais com múltiplas camadas (redes neurais profundas) para analisar grandes volumes de dados e reconhecer padrões complexos¹,¹²,¹³. Modelos como Redes Neurais Convolucionais (CNNs), Redes Neurais Recorrentes (RNNs) e Long Short-Term Memory (LSTM) são eficazes na análise de tráfego de rede e anomalias comportamentais¹⁴,¹⁵. As CNNs e RNNs, em particular, demonstram alta capacidade de reconhecer diversos padrões e identificar novas formas de ameaças¹⁴.

- Processamento de Linguagem Natural (NLP): Permite que as máquinas compreendam, interpretem e gerem linguagem humana⁴. É crucial para a análise de logs de segurança, identificação de ameaças baseadas em texto e detecção de phishing, ao analisar o conteúdo de e-mails e mensagens¹⁴.

- IA Generativa (GenAI): Modelos capazes de criar novos conteúdos, como texto, imagens ou código, a partir de dados existentes. Embora promissora para a automação da criação de relatórios de segurança e a identificação de vulnerabilidades¹⁷, a GenAI também abre novos vetores de ataque, como prompts maliciosos para manipular aplicativos de IA e a criação de deepfakes¹⁸,¹⁹.

- Explainable AI (XAI): Um conjunto de métodos projetados para tornar as decisões da IA compreensíveis e transparentes para os seres humanos²⁰. A XAI é crucial para a confiança e a colaboração humano-IA em cibersegurança, pois a opacidade de muitos modelos de IA pode dificultar a compreensão de suas conclusões, minando a confiança e a responsabilidade²¹,²². A XAI oferece uma solução promissora ao fornecer interpretabilidade e transparência, permitindo que os profissionais de segurança compreendam, confiem e otimizem melhor os modelos de sistemas de detecção de intrusão (IDS)²³.

2.2. Histórico e Marcos da Aplicação da IA na Segurança da Informação

A história da IA remonta à capacidade de máquinas replicarem habilidades humanas¹². A integração da IA na cibersegurança tem sido um processo evolutivo, impulsionado pela necessidade de lidar com a crescente sofisticação e volume das ameaças cibernéticas¹,⁹.

Inicialmente, a IA foi aplicada em tarefas mais simples, como análise de logs e automação de respostas básicas. Com o avanço do ML e DL, a IA passou a ser utilizada para detecção de anomalias, análise preditiva e resposta automatizada a incidentes¹,²,³. A capacidade da IA de aprender e se adaptar em tempo real tornou-se fundamental para identificar riscos proativamente e proteger ativos críticos¹.

A crescente complexidade dos ataques cibernéticos e o volume de dados de segurança gerados não apenas justificaram a adoção da IA, mas também impulsionaram a transição de métodos de ML tradicionais para DL e GenAI. Os métodos de DL e GenAI são mais eficazes na identificação de padrões complexos e na adaptação a novas ameaças, superando as limitações dos sistemas baseados em assinaturas que não são eficazes contra ameaças desconhecidas²⁴. Essa evolução reflete uma resposta contínua à dinâmica do cenário de ameaças, onde a capacidade de processar e aprender com grandes volumes de dados em tempo real é um diferencial competitivo para as defesas cibernéticas.

3. Metodologia

Este estudo baseia-se em uma revisão sistemática da literatura para analisar o papel da Inteligência Artificial na cibersegurança. A metodologia empregada visa garantir a abrangência e a relevância das fontes consultadas, seguindo um protocolo rigoroso para identificação, seleção e síntese dos estudos.

3.1. Fontes de Dados

A pesquisa foi conduzida em bases de dados científicas de alto impacto e visibilidade, reconhecidas pela sua abrangência e qualidade de conteúdo. As principais bases de dados utilizadas incluem:

- IEEE Xplore²⁵

- ACM Digital Library²⁶

- Scopus²⁷,²⁸

- ScienceDirect (Elsevier)²⁹

- Springer³⁰

- Google Scholar³¹

- arXiv³²

Além das bases de dados acadêmicas, foram consultados veículos de comunicação científica de grande visibilidade e impacto (como Nature, Wired, The Verge, MIT Tech Review) e livros de referência na área, incluindo “Metodologia de Pesquisa” de Sampierre et al. e conteúdo relevante do site https://maiquelgomes.com.br³³.

3.2. Estratégia de Busca

A estratégia de busca envolveu a utilização de termos-chave combinados com operadores booleanos para refinar os resultados. Os termos-chave incluíram: “Inteligência Artificial cibersegurança”, “Aprendizado de Máquina detecção de ameaças”, “Aprendizado Profundo segurança cibernética”, “IA generativa segurança”, “XAI cibersegurança”, “ataques adversariais IA”, “privacidade IA cibersegurança”, “regulamentação IA segurança”, “criptografia pós-quântica IA”, “aprendizado federado cibersegurança”, entre outros. Foram aplicados filtros de período para focar em publicações mais recentes, principalmente entre 2014 e 2024, período que coincide com avanços significativos em ML e DL e o surgimento de novas ameaças cibernéticas¹⁵,²⁸.

3.3. Critérios de Inclusão e Exclusão

- Inclusão: Artigos revisados por pares, anais de conferências de alto impacto (IEEE, ACM), capítulos de livros, relatórios técnicos de organizações reconhecidas e artigos de periódicos científicos relevantes. O conteúdo deveria abordar diretamente a aplicação da IA na cibersegurança, seus desafios, implicações éticas ou estratégias de mitigação.

- Exclusão: Artigos sem revisão por pares, publicações duplicadas, materiais irrelevantes para o tema central ou que não apresentassem rigor científico adequado.

3.4. Análise dos Dados

Os dados coletados foram submetidos a uma análise qualitativa, com o objetivo de sintetizar as informações, identificar tendências emergentes, lacunas de conhecimento e desafios persistentes. A análise focou na compreensão das aplicações defensivas e ofensivas da IA, nas vulnerabilidades inerentes aos sistemas de IA, nas implicações éticas e legais de sua adoção, e nas estratégias de mitigação propostas na literatura. Essa abordagem permitiu uma discussão aprofundada sobre a interconexão entre os diferentes aspectos da IA e da cibersegurança.

4. Análise de Dados: O Papel Dual da IA em Cibersegurança

A Inteligência Artificial desempenha um papel ambivalente no cenário da cibersegurança, atuando tanto como uma ferramenta poderosa para fortalecer as defesas quanto como um vetor para a orquestração de ataques mais sofisticados.

4.1. IA como Escudo: Aplicações Defensivas

A proficiência da IA no reconhecimento de padrões torna a detecção de anomalias um caso de uso óbvio⁴. A IA é amplamente utilizada para aprimorar a detecção de ameaças, a resposta a incidentes e a gestão de riscos, superando as limitações dos métodos tradicionais.

- Detecção de Ameaças e Anomalias: Sistemas baseados em Aprendizado de Máquina (ML) podem identificar o comportamento normal em um sistema e, assim, detectar desvios que sugerem potenciais violações de segurança⁴,⁸. Algoritmos como Random Forest (RF), Máquinas de Vetores de Suporte (SVM), k-Nearest Neighbors (kNN) e XGBoost são amplamente empregados para detectar ameaças, aprendendo padrões de ataque específicos¹⁴. Modelos de Aprendizado Profundo (DL), como Redes Neurais Convolucionais (CNNs) e Redes Neurais Recorrentes (RNNs), são particularmente eficazes na análise de tráfego de rede e anomalias comportamentais¹⁴,¹⁵. Por exemplo, um modelo LSTM treinado no conjunto de dados ToN-IoT demonstrou uma notável precisão de detecção de 99,41% para sistemas de detecção de intrusão (IDS)¹⁴.

- Automação da Resposta a Incidentes: A IA automatiza processos de segurança, o que reduz a sobrecarga das equipes humanas e permite que os profissionais se concentrem em riscos de maior prioridade¹. Sistemas de resposta a ameaças automatizados impulsionados por IA podem reduzir significativamente o tempo entre a detecção e a mitigação de uma ameaça, realizando tarefas como isolar sistemas afetados, aplicar patches e reverter ações maliciosas⁸,³⁴.

- Análise Preditiva e Inteligência de Ameaças: A IA pode prever onde e como um ataque pode ocorrer, permitindo a implementação de medidas preventivas⁸,³⁴. A análise de comportamento de usuários e entidades (UEBA), baseada em IA, pode identificar comportamentos anômalos que indicam ataques de dia zero ou ameaças internas²⁴,³⁵.

- Identificação de Vulnerabilidades e Gestão de Riscos: A IA detecta fragilidades em todo o ambiente digital, como dispositivos desconhecidos, aplicativos em nuvem desprotegidos, sistemas operacionais desatualizados ou dados confidenciais expostos¹⁷. Ferramentas de IA de empresas como o Google já descobriram dezenas de vulnerabilidades desconhecidas em softwares de código aberto, demonstrando a capacidade da IA de aumentar os métodos tradicionais de caça a bugs³⁶.

O desempenho de algoritmos de IA/ML em aplicações de cibersegurança, como detecção de intrusões e malware, tem sido consistentemente alto em estudos recentes. A Tabela 1 apresenta uma comparação de métricas de desempenho para alguns algoritmos notáveis.

Tabela 1: Métricas de Desempenho de Algoritmos de IA/ML em Cibersegurança

| Algoritmo/Modelo | Aplicação | Precisão (Accuracy) | F1-Score | Precisão (Precision) | Recall | Fonte |

| LSTM | IDS (ToN-IoT) | 99.41% | 99.33% | 99.35% | 99.32% | 1 |

| Random Forest | IDS (Binário) | >0.998 | >0.998 | – | – | 2 |

| Decision Tree | IDS (Binário) | >0.998 | >0.998 | – | – | 2 |

| CNN | Detecção de Malware | 99.99% | – | – | – | 3 |

| DNN | Detecção de Malware | 99.90% | – | – | – | 3 |

| RF, SGD, Extra Trees, Gaussian NB | Detecção de Malware | 100% | 1.00 | 1.00 | 1.00 | 4 |

Nota: Os valores de precisão, F1-score, precisão e recall podem variar dependendo do conjunto de dados, da configuração do modelo e da metodologia de avaliação utilizada em cada estudo.

4.2. IA como Espada: Aplicações Ofensivas e Ameaças Emergentes

A mesma capacidade da IA de aprender e automatizar processos que a torna valiosa para a defesa, também a torna uma ferramenta potente nas mãos de agentes maliciosos⁶,⁸.

- Ataques Adversariais: Um dos desafios mais significativos da IA envolve a manipulação de dados de entrada para confundir ou enganar um modelo de IA, resultando em erros graves⁵,²⁹. Isso inclui:

- Envenenamento de Dados (Data Poisoning): Atacantes injetam informações falsas ou enviesadas nos dados de treinamento de um modelo de IA, comprometendo sua precisão ou objetividade¹⁹,³⁷,³⁸. Isso pode levar a decisões incorretas ou comportamentos imprevisíveis do modelo⁵.

- Ataques de Evasão (Evasion Attacks): Alterações sutis nos dados de entrada fazem com que o modelo de IA classifique erroneamente um input malicioso como benigno, permitindo que o ataque passe despercebido¹⁹,³⁸.

- Adulteração de Modelo (Model Tampering): Alterações não autorizadas nos parâmetros ou na estrutura de um modelo de IA pré-treinado comprometem sua capacidade de produzir outputs precisos¹⁹.

- Ataques de Engenharia Social e Phishing Aprimorados por IA: A IA permite que os cibercriminosos automatizem e personalizem ataques de engenharia social em larga escala¹⁰. A IA generativa pode criar e-mails de phishing, mensagens SMS e interações em mídias sociais altamente realistas e personalizadas³⁹,¹⁹,⁴⁰. Chatbots baseados em IA podem automatizar a comunicação em tempo real, tornando-os quase indistinguíveis de humanos, o que permite que atacantes se conectem com inúmeras vítimas simultaneamente¹⁹.

- Deepfakes e Desinformação: A capacidade da IA de manipular conteúdo visual ou de áudio é usada para criar deepfakes que parecem legítimos¹⁰,¹⁹. Isso inclui o uso de áudio e vídeo falsos para se passar por indivíduos, que podem ser amplamente distribuídos online para causar estresse, medo ou confusão¹⁰. Deepfakes podem ser combinados com engenharia social e extorsão¹⁰. A manipulação de narrativas na esfera pública digital, facilitada pela IA, é uma preocupação crítica de cibersegurança relacionada à integridade da informação³³.

- Geração de Malware e Exploits: A IA pode ser usada para desenvolver malware adaptativo e explorar vulnerabilidades²,⁴. Equipes de Red Team utilizam métodos de IA, como classificação (árvores de decisão, CNN, RNN, LSTM, SVM), regressão (GAN, Random Forest) e estratégias de agrupamento (k-means clustering, RBM), para simular ciberataques, visando dados gerais, URLs, perfis de usuários de mídias sociais e senhas⁸. A capacidade da IA de aprender e replicar a linguagem natural pode levar à criação de malware que gera e-mails de phishing altamente personalizados e críveis⁴¹.

- Ameaças Quânticas: A convergência da computação quântica e da IA representa uma ameaça futura significativa para a cibersegurança⁵,⁴². Computadores quânticos, uma vez poderosos o suficiente, poderiam quebrar protocolos criptográficos atuais, como RSA e ECC, que são a base da segurança de dados hoje¹³,⁵,⁴². A IA aprimorada por computação quântica poderia criar malware que aprende, se adapta e muda seu comportamento em tempo real para contornar as defesas tradicionais⁵. Se acessíveis a cibercriminosos, botnets poderiam ser controlados por algoritmos quânticos, aumentando sua eficiência e dificultando seu rastreamento e desmantelamento⁵.

5. Discussão: Desafios, Implicações Éticas e Regulatórias e Estratégias de Mitigação

A integração da Inteligência Artificial na cibersegurança, embora promissora, traz consigo uma série de desafios e levanta questões éticas e legais complexas que precisam ser abordadas para garantir um futuro digital seguro e responsável.

5.1. Desafios e Vulnerabilidades da IA na Cibersegurança

A eficácia dos modelos de IA depende criticamente da qualidade dos dados utilizados para seu treinamento⁵. Se um atacante conseguir manipular esses dados, injetando informações falsas ou enviesadas, o modelo pode ser treinado incorretamente, resultando em decisões erradas ou comportamentos imprevisíveis⁵,³⁷. Este risco é conhecido como “envenenamento de dados”⁵.

Modelos de IA, especialmente os de Aprendizado Profundo, podem ser suscetíveis a ataques adversariais, nos quais dados maliciosamente alterados são usados para enganar o modelo, levando-o a tomar decisões erradas ou prejudiciais⁵,²⁹. Esses ataques podem explorar falhas nos algoritmos de IA, forçando-os a reconhecer padrões falsos ou ignorar ameaças reais⁵.

A natureza de “caixa preta” de muitos algoritmos de IA, onde seus processos de tomada de decisão são opacos, dificulta a compreensão de como eles chegam às suas conclusões⁵,²¹,²². Essa falta de clareza pode minar a confiança nas ferramentas de cibersegurança baseadas em IA e impedir sua ampla adoção²². A XAI busca resolver essa questão, mas enfrenta desafios como a sobrecarga computacional, que pode dificultar a detecção em tempo real²³,⁴³.

Modelos de ML consomem volumes massivos de dados, incluindo informações sensíveis⁵,⁴⁴. A exfiltração de dados pode resultar de vulnerabilidades técnicas ou de controles de acesso insuficientes⁴⁴. Atacantes podem explorar vulnerabilidades ou usar esquemas de phishing para ter acesso e roubar dados sensíveis usados no treinamento e afinação dos modelos de ML⁴⁴. Além disso, a IA generativa oferece novos vetores de ataque a serem explorados, como prompts maliciosos para manipular aplicativos de IA¹⁸.

A IA também é vulnerável a ataques na cadeia de suprimentos, onde atacantes podem explorar vulnerabilidades em toolchains abertas, bibliotecas de terceiros e APIs vulneráveis⁴⁴. A injeção de prompts maliciosos pode fazer jailbreak em LLMs (Large Language Models), permitindo acessos indevidos, roubo de dados sensíveis ou geração de outputs adulterados/com viés⁴⁴.

5.2. Implicações Éticas e Legais

A aplicação da IA na cibersegurança levanta questões éticas e legais profundas, que vão desde o viés algorítmico até a responsabilidade por decisões automatizadas.

- Viés e Discriminação: Algoritmos de IA são treinados com base em dados históricos, o que pode introduzir viés nos resultados⁵. Isso significa que a IA pode perpetuar e amplificar preconceitos existentes refletidos nos dados de treinamento, o que é uma preocupação significativa quando se trata de decisões importantes, como contratações ou processos judiciais, podendo levar a decisões injustas e prejudiciais⁵,³⁷,⁴⁵.

- Privacidade e Proteção de Dados: A vasta capacidade computacional da IA para analisar dados levanta preocupações sobre a privacidade individual e a possibilidade de vigilância excessiva²²,⁴⁵. A coleta, armazenamento e processamento de dados pessoais pela IA precisam aderir a regulamentações rigorosas como o General Data Protection Regulation (GDPR) da União Europeia⁵,⁴⁶. O site Maiquel Gomes destaca a discussão sobre “A Esfera Pública Digital em Xeque: Ética, Polarização e Manipulação de Narrativas na Era da Inteligência Artificial”³³, o que se alinha diretamente com as preocupações sobre a integridade da informação e as operações de influência que a IA pode facilitar.

- Responsabilidade e Prestação de Contas: A tomada de decisões automatizada levanta questões complexas sobre quem é responsável por erros ou decisões incorretas em sistemas de IA⁵,⁴⁵. Garantir que a IA seja usada de maneira ética e para o bem da sociedade exige que os sistemas de IA sejam auditáveis e rastreáveis, com mecanismos de supervisão e avaliação de impacto em vigor⁴⁵.

- Deslocamento de Empregos: A crescente automação de tarefas de cibersegurança por meio da IA pode levar ao deslocamento de empregos na indústria, gerando um dilema ético sobre o impacto social da tecnologia²².

- Regulamentação e Governança: Devido às crescentes preocupações, muitos países e organizações internacionais têm tomado medidas para regular o uso da IA⁵. A União Europeia introduziu a Lei de Inteligência Artificial, que estabelece diretrizes rigorosas para garantir a segurança, ética e transparência na sua utilização⁵. Outros frameworks importantes incluem o NIST AI Risk Management Framework (USA) e os Princípios de IA da OCDE⁴⁷,⁴⁸. A Cybersecurity and Infrastructure Security Agency (CISA) dos EUA também lançou orientações para operadores de sistemas de IA sobre a gestão de riscos de segurança de dados⁴⁹. A governança da IA é fundamental para garantir que os modelos sejam justos, imparciais e em conformidade com as regulamentações internacionais⁴⁸.

5.3. Estratégias de Mitigação e o Futuro da Cibersegurança com IA

Para enfrentar os desafios e ameaças impostos pela IA, é essencial desenvolver e implementar estratégias de mitigação robustas, que combinem avanços tecnológicos com uma governança ética e regulatória.

- IA contra IA: Uma abordagem promissora é usar a própria IA para identificar e defender contra ameaças cibernéticas⁸,⁴¹. Sistemas de detecção de anomalias baseados em IA inspecionam o tráfego de rede e o comportamento do usuário em busca de padrões incomuns que indicam ciberataques⁸. Ao aprender continuamente com o comportamento normal, esses sistemas podem detectar desvios que sugerem potenciais violações de segurança⁸. Além disso, sistemas de resposta a ameaças automatizados impulsionados por IA podem reduzir significativamente o tempo entre a detecção e a mitigação de uma ameaça, realizando tarefas como isolar sistemas afetados, aplicar patches e reverter ações maliciosas⁸.

- Aprendizado Federado (FL): O FL permite o treinamento colaborativo de modelos de IA em dados descentralizados, sem a necessidade de transferir os dados brutos sensíveis⁵⁰. Isso fortalece a segurança, protege a privacidade e preserva o controle operacional, sendo crucial para setores sensíveis e regulamentados como saúde e defesa⁵⁰,⁵¹. O FL minimiza as superfícies de ataque compartilhadas e permite que os sistemas validem atualizações sem transferir dados sensíveis⁵¹.

- Criptografia Pós-Quântica (PQC): Com o avanço da computação quântica e a ameaça que ela representa para os protocolos criptográficos atuais, a pesquisa e o desenvolvimento de algoritmos criptográficos resistentes a ataques quânticos são cruciais para garantir a segurança dos dados no futuro⁵,⁴².

- Modelos Híbridos (Humano-IA): A colaboração entre humanos e IA é fundamental para o futuro da cibersegurança. Embora a IA possa analisar grandes volumes de dados e identificar ameaças em tempo real, a validação humana, a interpretação e a tomada de decisões estratégicas continuam sendo essenciais²¹,³⁶. A IA atua como um multiplicador de força, mas a engenhosidade humana permanece o ponto central³⁶.

- Governança e Auditoria Contínua: A implementação de frameworks de governança de IA, como os propostos pela UNESCO, OCDE, NIST e CISA, é vital para garantir que a IA seja desenvolvida e implantada de forma segura e ética⁴⁵,⁴⁷,⁴⁸,⁴⁹. Isso inclui a realização de avaliações de risco contínuas, o monitoramento do desempenho dos sistemas de IA e a auditoria regular para garantir a conformidade com as regulamentações e mitigar vieses⁴⁷,⁴⁸.

- Educação e Conscientização: Promover a compreensão pública da IA e da ética da IA é um dos princípios fundamentais da Recomendação da UNESCO sobre a Ética da Inteligência Artificial⁴⁵. A educação e o treinamento contínuos para profissionais de cibersegurança e usuários são essenciais para lidar com as ameaças em evolução.

- Colaboração e Compartilhamento de Informações: A colaboração entre organizações, agências governamentais e pesquisadores de cibersegurança é essencial para criar defesas robustas contra ameaças impulsionadas pela IA⁸. O compartilhamento de inteligência sobre ameaças e as melhores práticas pode fortalecer a resiliência coletiva.

6. Conclusão

A Inteligência Artificial emergiu como um pilar transformador no domínio da cibersegurança, oferecendo capacidades sem precedentes para otimizar defesas e mitigar ameaças em um cenário digital cada vez mais complexo. A capacidade da IA de processar e analisar vastos volumes de dados em tempo real permite a detecção proativa de anomalias, a automação de respostas a incidentes e a análise preditiva, superando as limitações da capacidade humana diante da escala e sofisticação das ameaças. O crescimento exponencial projetado para o mercado de IA em cibersegurança sublinha a sua indispensabilidade estratégica e a mudança fundamental na alocação de recursos das organizações para soluções baseadas em IA.

Contudo, o poder da IA é uma espada de dois gumes. A mesma tecnologia que protege é também explorada por agentes maliciosos para orquestrar ataques mais sofisticados e evasivos, incluindo ataques adversariais, phishing aprimorado por IA, deepfakes e a geração de malware e exploits. As vulnerabilidades inerentes aos próprios sistemas de IA, como o envenenamento de dados e a falta de transparência (“caixa preta”), representam desafios significativos que exigem atenção contínua.

Além dos aspectos técnicos, a integração da IA na cibersegurança levanta profundas implicações éticas e legais. Questões como viés e discriminação algorítmica, a preservação da privacidade dos dados e a definição de responsabilidade em decisões automatizadas são cruciais. A necessidade de uma governança robusta da IA, com frameworks regulatórios e éticos claros, é imperativa para garantir que a tecnologia seja desenvolvida e utilizada de forma responsável e para o bem da sociedade.

Em última análise, a IA não é uma panaceia para todos os problemas de cibersegurança, mas um componente vital que exige uma abordagem holística. A colaboração humano-IA, onde a IA acelera a análise e a automação, enquanto a supervisão e a interpretação humanas garantem a tomada de decisões estratégicas e éticas, é o caminho a seguir. O desenvolvimento contínuo de técnicas de Explainable AI (XAI), a pesquisa em Aprendizado Federado para proteger a privacidade dos dados e o avanço da Criptografia Pós-Quântica são áreas críticas para o futuro da cibersegurança.

Limitações deste estudo incluem o fato de que, como uma revisão da literatura, ele reflete o estado do conhecimento até a data da pesquisa, e a área de IA e cibersegurança está em constante e rápida evolução. Pesquisas futuras devem focar no desenvolvimento de XAI mais eficaz e menos custoso, na padronização de métricas de desempenho para IA defensiva em cenários do mundo real, e na exploração de soluções inovadoras para mitigar as ameaças emergentes da IA ofensiva e da computação quântica.

7. Referências

¹ Zscaler. O que é Inteligência Artificial (IA) na Segurança Cibernética. Disponível em: https://www.zscaler.com/br/zpedia/what-is-artificial-intelligence-ai-in-cybersecurity. Acesso em: 06 ago. 2025.

² SPMS. Desafios de Cibersegurança na Era da Inteligência Artificial. Disponível em: https://www.spms.min-saude.pt/2024/10/desafios-de-ciberseguranca-na-era-da-inteligencia-artificial/. Acesso em: 06 ago. 2025.

³ PUC Minas. A integração da inteligência artificial (IA) na cibersegurança. Disponível em: https://www.youtube.com/watch?v=b7n7kLFfsNc. Acesso em: 06 ago. 2025.

⁴ Red Hat. 4 Casos de Uso de IA em Cibersegurança. Disponível em: https://www.redhat.com/pt-br/blog/4-use-cases-ai-cyber-security. Acesso em: 06 ago. 2025.

⁵ AccessIT Group. Quantum Computing, Artificial Intelligence, and the Cybersecurity Threat Landscape. Disponível em: https://www.accessitgroup.com/quantum-computing-artificial-intelligence-and-the-cybersecurity-threat-landscape/. Acesso em: 06 ago. 2025.

⁶ IBM. Segurança de IA. Disponível em: https://www.ibm.com/br-pt/topics/cybersecurity. Acesso em: 06 ago. 2025.

⁷ ArXiv. The progress of artificial intelligence (AI) has made sophisticated methods available for cyberattacks and red team activities. Disponível em: https://arxiv.org/html/2503.19626. Acesso em: 06 ago. 2025.

⁸ ArXiv. Red Teaming with Artificial Intelligence-Driven Cyberattacks: A Scoping Review. Disponível em: https://arxiv.org/html/2503.19626. Acesso em: 06 ago. 2025.

⁹ ResearchGate. AN OVERVIEW OF ARTIFICIAL INTELLIGENCE IN CYBERSECURITY OPPORTUNITIES AND CHALLENGES. Disponível em: https://www.researchgate.net/publication/375497186_AN_OVERVIEW_OF_ARTIFICIAL_INTELLIGENCE_IN_CYBERSECURITY_OPPORTUNITIES_AND_CHALLENGES. Acesso em: 06 ago. 2025.

¹⁰ Morgan Stanley. AI and Cybersecurity: A New Era. Disponível em: https://www.morganstanley.com/articles/ai-cybersecurity-new-era. Acesso em: 06 ago. 2025.

¹¹ MDPI. AI is being leveraged to solve a number of problems. Disponível em: https://www.mdpi.com/2079-9292/14/10/2057. Acesso em: 06 ago. 2025.

¹² Escola Virtual. A História da IA. Disponível em: https://www.escolavirtual.gov.br/curso/1088. Acesso em: 06 ago. 2025.

¹³ Atena Editora. Os conceitos fundamentais da IA incluem algoritmos de aprendizagem de máquina. Disponível em: https://atenaeditora.com.br/catalogo/dowload-post/75570. Acesso em: 06 ago. 2025.

¹⁴ ResearchGate. Cyber security meets artificial intelligence: a survey. Disponível em: https://www.researchgate.net/publication/330286180_Cyber_security_meets_artificial_intelligence_a_survey. Acesso em: 06 ago. 2025.

¹⁵ Taylor & Francis Online. A comprehensive literature review was conducted on the application of AI in cybersecurity from 2014 to 2024. Disponível em: https://www.tandfonline.com/doi/full/10.1080/08839514.2024.2439609. Acesso em: 06 ago. 2025.

¹⁶ DiVA Portal. Models are assessed based on accuracy, precision, recall, F1-score, and computational time. Disponível em: https://su.diva-portal.org/smash/get/diva2:1971980/FULLTEXT01.pdf. Acesso em: 06 ago. 2025.

¹⁷ Microsoft. O que é IA para cibersegurança. Disponível em: https://www.microsoft.com/pt-br/security/business/security-101/what-is-ai-for-cybersecurity. Acesso em: 06 ago. 2025.

¹⁸ Trend Micro. Vulnerabilidades de Segurança da IA. Disponível em: https://www.trendmicro.com/pt_br/what-is/ai/security-risks.html. Acesso em: 06 ago. 2025.

¹⁹ CrowdStrike. Most Common AI-Powered Cyberattacks. Disponível em: https://www.crowdstrike.com/en-us/cybersecurity-101/cyberattacks/ai-powered-cyberattacks/. Acesso em: 06 ago. 2025.

²⁰ ResearchGate. Explainable AI for Cybersecurity Applications: A Review Article on Techniques, Deployments, and Usability Challenges. Disponível em: https://www.researchgate.net/publication/393193720_Explainable_AI_for_Cybersecurity_Applications_A_Review_Article_on_Techniques_Deployments_and_Usability_Challenges. Acesso em: 06 ago. 2025.

²¹ IT Security. Os desafios de segurança da informação na era da inteligência artificial. Disponível em: https://www.itsecurity.pt/news/expert/os-desafios-de-seguranca-da-informacao-na-era-da-inteligencia-artificial. Acesso em: 06 ago. 2025.

²² Cognixia. Ethical Artificial Intelligence (AI) in Cybersecurity. Disponível em: https://www.cognixia.com/blog/ethical-artificial-intelligence-ai-in-cybersecurity/. Acesso em: 06 ago. 2025.

²³ Frontiers. A systematic review on the integration of explainable artificial intelligence in intrusion detection systems to enhancing transparency and interpretability in cybersecurity. Disponível em: https://www.frontiersin.org/journals/artificial-intelligence/articles/10.3389/frai.2025.1526221/full. Acesso em: 06 ago. 2025.

²⁴ Palo Alto Networks. What are Predictions of Artificial Intelligence (AI) in Cybersecurity? Disponível em: https://www.paloaltonetworks.com/cyberpedia/predictions-of-artificial-intelligence-ai-in-cybersecurity. Acesso em: 06 ago. 2025.

²⁵ MDPI. Moreover, AI-driven attacks, vulnerabilities in edge computing infrastructures. Disponível em: https://www.mdpi.com/2076-3417/15/15/8704. Acesso em: 06 ago. 2025.

²⁶ EPALE. Towards AI-Literate Future: Systematic Literature Review. Disponível em: https://epale.ec.europa.eu/en/resource-centre/content/towards-ai-literate-future-systematic-literature-review. Acesso em: 06 ago. 2025.

²⁷ Elsevier. Scopus AI. Disponível em: https://www.elsevier.com/products/scopus/scopus-ai. Acesso em: 06 ago. 2025.

²⁸ Scopus. These applications range from anomaly detection and threat identification to predictive analytics and automated incident response. Disponível em: https://www.tandfonline.com/doi/full/10.1080/08839514.2024.2439609. Acesso em: 06 ago. 2025.

²⁹ EC-Council. Certified Ethical Hacker (CEH). Disponível em: https://www.eccouncil.org/train-certify/certified-ethical-hacker-ceh/. Acesso em: 06 ago. 2025.

³⁰ Springer Professional. Network Security Empowered by Artificial Intelligence. Disponível em: https://www.springerprofessional.de/en/network-security-empowered-by-artificial-intelligence/27255704. Acesso em: 06 ago. 2025.

³¹ Dimensions. We make finding and interpreting global research data fast and simple. Disponível em: https://www.dimensions.ai/. Acesso em: 06 ago. 2025.

³² ArXiv. This study conducts a systematic literature review (SLR) to analyze and compare AI-driven security solutions in DevSecOps. Disponível em: https://arxiv.org/html/2504.19154v1. Acesso em: 06 ago. 2025.

³³ Gomes, M. Inteligência Artificial e Criptomoedas: Otimizando o Futuro das Finanças Descentralizadas e Superando Desafios Regulatórios. Disponível em: https://maiquelgomes.com.br. Acesso em: 06 ago. 2025.

³⁴ Check Point. A IA tem o potencial de revolucionar muitos setores, inclusive o de segurança cibernética. Disponível em: https://www.checkpoint.com/pt/cyber-hub/cyber-security/what-is-ai-security/ai-security-risks-and-threats/. Acesso em: 06 ago. 2025.

³⁵ ResearchGate. The results demonstrate that AI-Assisted SOC consistently outperforms other alternatives. Disponível em: https://www.researchgate.net/publication/330286180_Cyber_security_meets_artificial_intelligence_a_survey. Acesso em: 06 ago. 2025.

³⁶ WebProNews. Google’s AI Tool Uncovers 20 New Vulnerabilities in Open-Source Software. Disponível em: https://www.webpronews.com/googles-ai-tool-uncovers-20-new-vulnerabilities-in-open-source-software/. Acesso em: 06 ago. 2025.

³⁷ SPMS. A Inteligência Artificial oferece benefícios, como a automação e análise de dados, mas traz desafios de cibersegurança. Disponível em: https://www.spms.min-saude.pt/2024/10/desafios-de-ciberseguranca-na-era-da-inteligencia-artificial/. Acesso em: 06 ago. 2025.

³⁸ IT Security. Os ataques adversariais são um dos desafios mais significativos da IA. Disponível em: https://www.itsecurity.pt/news/expert/os-desafios-de-seguranca-da-informacao-na-era-da-inteligencia-artificial. Acesso em: 06 ago. 2025.

³⁹ World Economic Forum. 3 ways AI will change the nature of cyber attacks. Disponível em: https://www.weforum.org/stories/2019/06/ai-is-powering-a-new-generation-of-cyberattack-its-also-our-best-defence/. Acesso em: 06 ago. 2025.

⁴⁰ ArXiv. The possibility of artificial intelligence (AI) simulating human behavior has emerged as a significant cybersecurity threat. Disponível em: https://arxiv.org/html/2503.19626. Acesso em: 06 ago. 2025.

⁴¹ MIT News. 3 Questions: Modeling adversarial intelligence to exploit AI’s security vulnerabilities. Disponível em: https://news.mit.edu/2025/3-questions-una-may-o-reilly-modeling-adversarial-intelligence-0129. Acesso em: 06 ago. 2025.

⁴² Forbes. The Clock Is Ticking On AI Security In A Quantum World. Disponível em: https://www.forbes.com/sites/kolawolesamueladebayo/2025/08/05/the-clock-is-ticking-on-ai-security-in-a-quantum-world/#:~:text=Once%20quantum%20machines%20become%20powerful,passed%20through%20AI%20models%20today.. Acesso em: 06 ago. 2025.

⁴³ ArXiv. The accuracy of the Random Forest model was at the highest of 99.24%. Disponível em: https://arxiv.org/html/2504.17930v1. Acesso em: 06 ago. 2025.

⁴⁴ Academia PME. IA na cibersegurança. Disponível em: https://academiapme.iapmei.pt/pluginfile.php/24820/mod_page/content/420/IA%20na%20ciberseguran%C3%A7a.pdf. Acesso em: 06 ago. 2025.

⁴⁵ UNESCO. Ethics of Artificial Intelligence. Disponível em: https://www.unesco.org/en/artificial-intelligence/recommendation-ethics. Acesso em: 06 ago. 2025.

⁴⁶ Zscaler. AI in Cybersecurity: Navigating GDPR, Privacy Laws, and Risk Management. Disponível em: https://www.zscaler.com/blogs/product-insights/ai-cybersecurity-navigating-gdpr-privacy-laws-and-risk-management. Acesso em: 06 ago. 2025.

⁴⁷ Essert Inc. AI Governance Frameworks for Cybersecurity- What You Need to Know. Disponível em: https://essert.io/ai-governance-frameworks-for-cybersecurity/. Acesso em: 06 ago. 2025.

⁴⁸ Consilien. AI Governance Frameworks: Guide to Ethical AI Implementation. Disponível em: https://consilien.com/news/ai-governance-frameworks-guide-to-ethical-ai-implementation. Acesso em: 06 ago. 2025.

⁴⁹ Inside Privacy. CISA Releases AI Data Security Guidance. Disponível em: https://www.insideprivacy.com/cybersecurity-2/cisa-releases-ai-data-security-guidance/. Acesso em: 06 ago. 2025.

⁵⁰ Research AIMultiple. Federated Learning: 5 Use Cases & Real Life Examples [’25]. Disponível em: https://research.aimultiple.com/federated-learning/. Acesso em: 06 ago. 2025.

⁵¹ AFCEA International. Decentralized Defense: How Federated Learning Strengthens U.S. AI. Disponível em: https://www.afcea.org/signal-media/decentralized-defense-how-federated-learning-strengthens-us-ai. Acesso em: 06 ago. 2025.

Graduado em Ciências Atuariais pela Universidade Federal Fluminense (UFF) e mestrando em Computação.Palestrante e Professor de Inteligência Artificial e Linguagem de Programação; autor de livros, artigos e aplicativos.Professor do Grupo de Trabalho em Inteligência Artificial da UFF (GT-IA/UFF) e do Laboratório de Inovação, Tecnologia e Sustentabilidade (LITS/UFF), entre outros projetos.

Proprietário dos portais:🔹 ia.pro.br🔹 ia.bio.br🔹 ec.ia.br🔹 iappz.com🔹 maiquelgomes.com🔹 ai.tec.reentre outros.

💫 Apaixonado pela vida, pelas amizades, pelas viagens, pelos sorrisos, pela praia, pelas baladas, pela natureza, pelo jazz e pela tecnologia.